Data Studio: Connecting BigQuery and Google Sheets to help with hefty data analysis

Note: This post is over 6 years old. The information may be outdated.

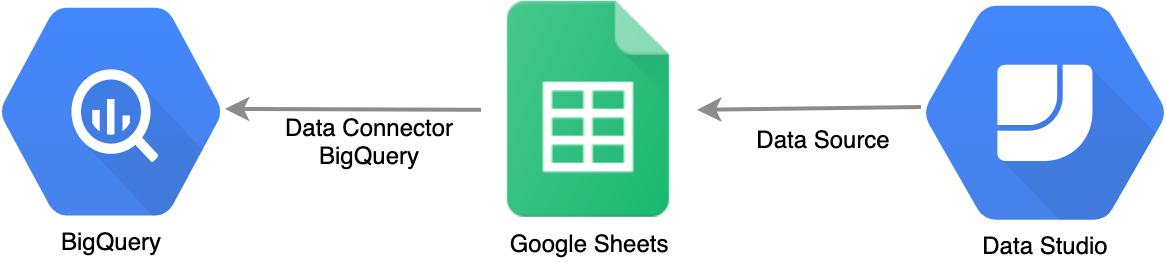

Normally, with BigQuery as a data source of Data Studio, it’s should be:

The problems:

- Users (of Data Studio Dashboard) might end up generating a lot of queries on your behalf — and that means you can end up with a huge BigQuery bill.

- It’s taken so long to refresh data when you change something in development mode.

- The easiest way to avoid pushing new queries from Data Studio into BigQuery is to materialize the results of your queries into Data Studio. But right now that feature is still in development, and it will be subject to certain limitations — so we also shared some other options to create an inexpensive layer between Data Studio and BigQuery.

Google Sheets as a Caching layer

With the Sheets data connector for BigQuery, you can cache the calculated data for Data Studio. Then, use Data Studio connects to that sheet to reduce the time load and avoid pushing queries to BigQuery, and Spreadsheet is free.

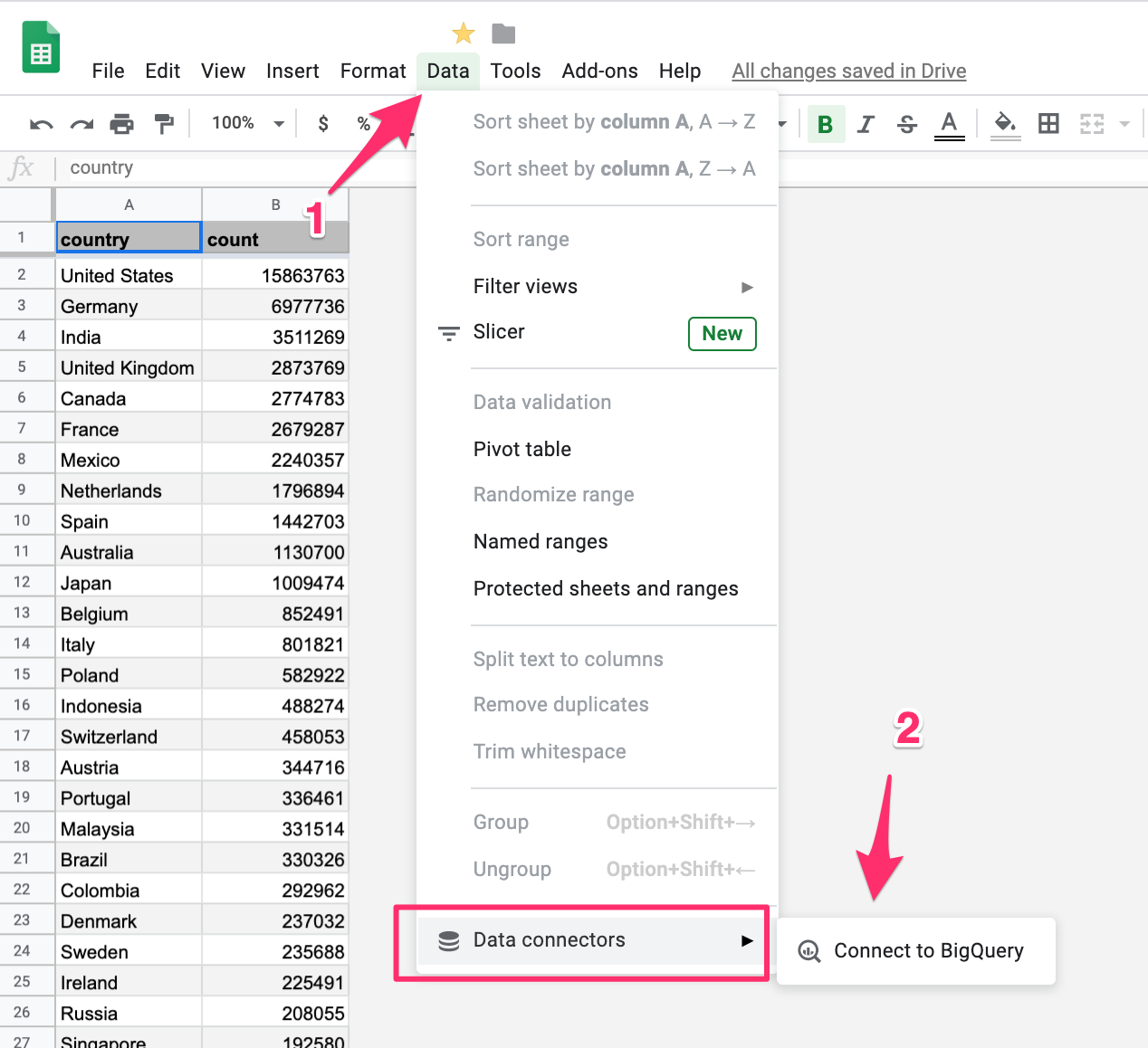

Sheets data connector for BigQuery

-

Google Sheets

-

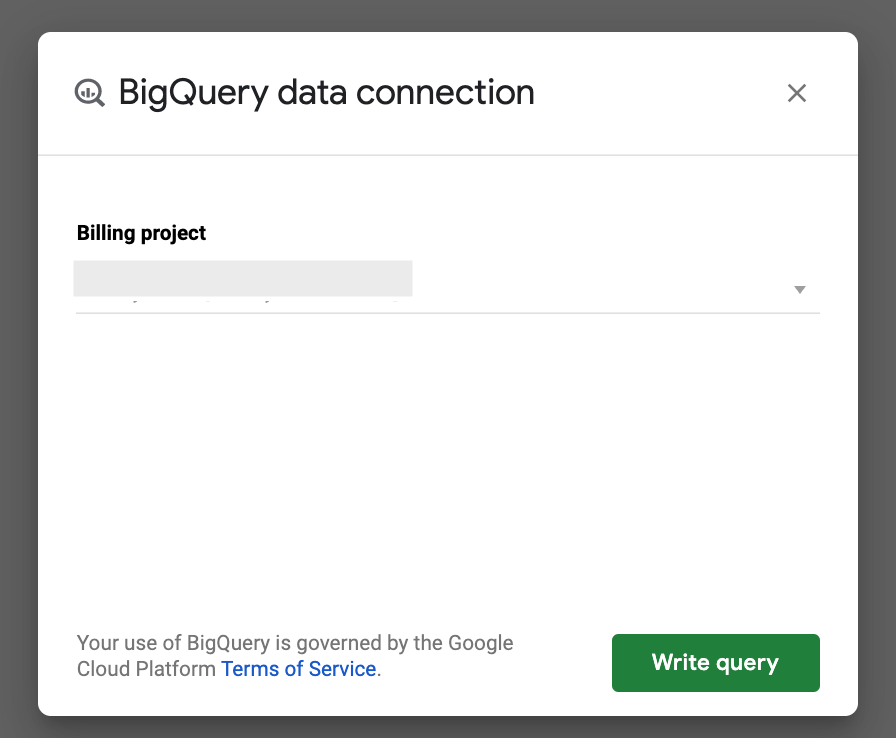

Choose Billing Project

-

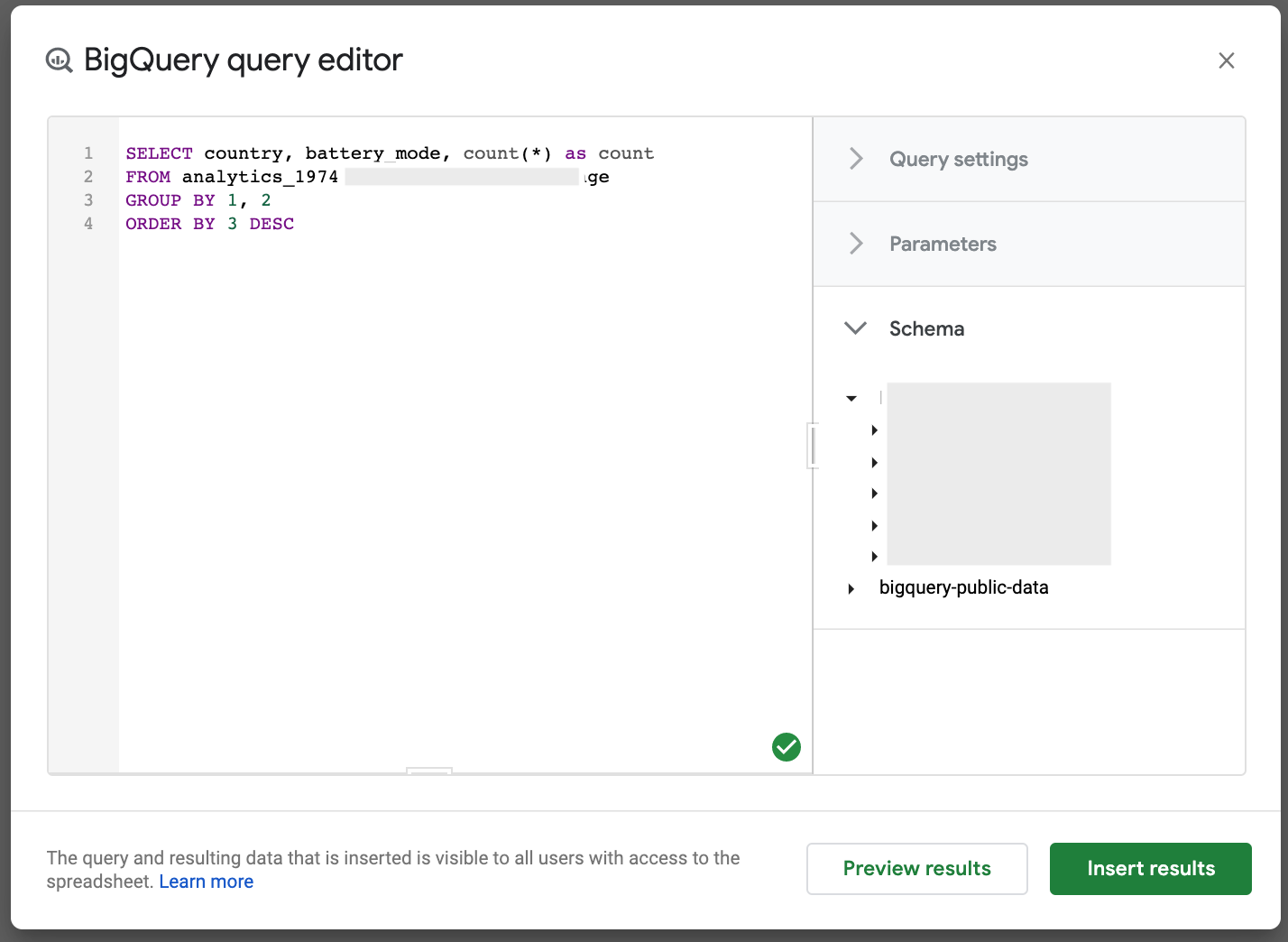

Write a Query

-

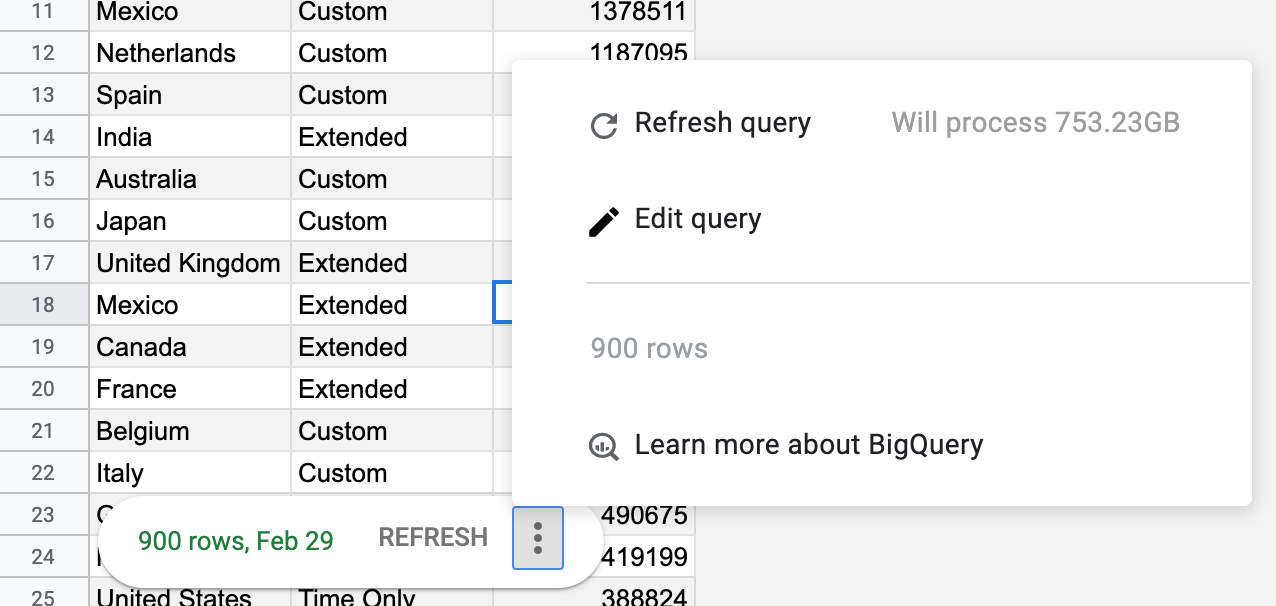

Refresh Manually

-

Schedule automatic updates: You'll be able to use tools like Apps Script and the macro recorder to schedule automatic updates to the connected BigQuery data.

Good luck!

References

Related Posts

Spark on Kubernetes Performance Tuning

Spark Performance tuning is a process to improve the performance of Spark. In this post, I will focus on Spark running on Kubernetes.

Airflow 2.0 - Taskflow API

Chú trọng vào việc đơn giản hóa và rõ ràng cách viết Airflow DAG, cách trao đổi thông tin giữa các tasks, Airflow 2.0 ra mắt Taskflow API cho phép viết đơn giản và gọn gàng hơn so với cách truyền thống, đặc biệt vào các pipelines sử dụng PythonOperators.

Tại sao nên triển khai Apache Spark trên Kubernetes

Spark đã quá nổi tiếng trong thế giới Data Engineering và Bigdata. Kubernetes cũng ngày càng phổ biến tương tự, là một hệ thống quản lý deployment và scaling application. Bài viết này bàn đến một số lợi ích khi triển khai ứng dụng Apache Spark trên hệ thống Kubernetes.

Scheduling Python script in Airflow

To schedule a Python script or Python function in Airflow, we use `PythonOperator`. For Airflow 2.0+, consider using the TaskFlow API for a more modern approach.